Il medico del futuro è un algoritmo?

Il futuro della sanità potenziata con l’AI

Immaginiamo un futuro in cui una tecnologia sia in grado di valutare il nostro stato di salute, rilevare la possibile presenza di patologie e proporre trattamenti personalizzati basati sulle nostre caratteristiche psicofisiche. Non serve essere i protagonisti di un episodio di Black Mirror – la serie britannica che esplora, in chiave distopica e speculativa, le implicazioni sociali, etiche e psicologiche dell’innovazione tecnologica – per visualizzare uno scenario del genere. Quel futuro, infatti, è già presente.

Tra gli esperti del settore sanitario infatti, si discute già da tempo del potenziale contributo dell’intelligenza artificiale alla medicina del futuro, grazie alla sua capacità di analizzare e interpretare grandi quantità di dati in modo rapido e più o meno accurato.

Ma come si fa a introdurre nel percorso clinico-terapeutico una nuova tecnologia e renderla una vera “innovazione”? Chi sono i protagonisti e quali sono le implicazioni etiche e sociali dell’introduzione di algoritmi volti a guidare le decisioni cliniche?

Sfide all’integrazione dell’AI nella pratica clinica

Sono numerosi i fattori che contribuiscono oggi ad aggravare lo stato di salute dell’umanità. Tra questi figurano problemi strutturali legati al cambiamento climatico, alla crescente preoccupazione per la salute mentale, alle disuguaglianze socioeconomiche e all’accesso ineguale ai servizi sanitari. A tali problematiche strutturali si aggiungono poi problemi contestuali che interessano, in misura variabile, gran parte dei sistemi sanitari nazionali mondiali. Tra questi si annoverano le maggiori aspettative riposte nella medicina, l’aumento della popolazione globale e il progressivo invecchiamento della stessa, nonché i costi crescenti legati allo sviluppo e all’adozione di nuove tecnologie.

Sebbene molti di questi problemi, per la loro complessità e dimensione, non possano essere risolti da un algoritmo, gli esperti concordano sul fatto che l’intelligenza artificiale possa offrire soluzioni efficaci per affrontarne alcuni aspetti. Fabrizio D’Alba, direttore generale del Policlinico Umberto I di Roma e presidente di Federsanità, sottolinea ad esempio che “L’intelligenza artificiale è uno strumento che può rendere più accurata l’attività dei professionisti, semplificarla e ridurre i tempi necessari per alcune decisioni critiche”.

È evidente, quindi, che l’intelligenza artificiale può svolgere molteplici compiti assegnati dai medici, supportandoli nel miglioramento e nella semplificazione di gran parte del loro lavoro.

Le possibile applicazioni nella sanità

Le applicazioni dell’AI in sanità infatti sono molteplici, e a questo proposito ricordiamo la presenza di algoritmi capaci di analizzare immagini radiologiche per rilevare patologie con una buona performance diagnostica, di sistemi come DrugGpt che aiutano a identificare nuove potenziali molecole da utilizzare a scopo terapeutico, e di chatbot avanzati capaci di assistere i medici nella gestione di diagnosi preliminari e follow-up.

Tutto appare semplice e promettente, almeno in teoria, ma approfondendo il funzionamento di questi sistemi emerge che il vero perno dell’innovazione risiede nella raccolta e nella gestione accurata dei dati. I sistemi di machine learning e deep learning si basano infatti su enormi dataset per identificare pattern, fare previsioni e ottimizzare processi complessi. È qui che sorgono alcune delle sfide più rilevanti. Da un lato, modelli addestrati su dati provenienti da popolazioni specifiche possono introdurre bias discriminatori verso gruppi etnici o sociali minoritari. Dall’altro, il trattamento di dati sensibili, come quelli sanitari, richiede il rispetto di rigorosi protocolli di sicurezza, come evidenziato dall’OMS nel report Regulatory Considerations on Artificial Intelligence for Health.

Per un’integrazione sana e costruttiva dell’intelligenza artificiale nella pratica medica, dunque è innanzitutto fondamentale riconoscere che essa non può né deve sostituire il ruolo del medico. Solo un medico, infatti, può comprendere appieno le complessità della vita umana e del rapporto tra mente, corpo e ambiente, instaurare una connessione emotiva con il paziente, generare fiducia nel paziente, gestirne l’ansia e motivarlo ad affrontare trattamenti complessi o cambiamenti nello stile di vita. È il medico che tiene conto della volontà del paziente, dei suoi valori morali, e che trova soluzioni creative e sensibili, adattandosi al contesto specifico. L’intelligenza artificiale deve dunque essere vista come uno strumento complementare, non come un sostituto. Al contrario, il professionista sanitario deve acquisire le competenze necessarie per comprenderne il funzionamento e sfruttarne il potenziale, con l’obiettivo finale di migliorare la cura del paziente.

In ogni caso, siamo ancora lontani dal poter basare diagnosi o terapie esclusivamente sugli algoritmi. Il cosiddetto “occhio clinico” resta imprescindibile per individuare le peculiarità del paziente e registrarle in modo accurato nel suo Fascicolo Sanitario Elettronico. Durante il Forum Sanità 2024, Maria Immacolata Cammarota, responsabile del progetto FSE presso il Dipartimento per la Trasformazione Digitale, ha sottolineato che solo a partire da dati di alta qualità è possibile generare una conoscenza altrettanto valida e utile attraverso l’AI. Questo evidenzia come la tecnologia possa diventare un alleato prezioso per il personale medico, a patto che esso si impegni a raccogliere, organizzare e interpretare i dati con precisione e competenza. “Oggi – sostiene la Dottoressa Cammarota- parliamo non solo di big data, ma di good data, ovvero dati accurati e affidabili su cui costruire una conoscenza buona e consapevole”. È evidente quindi che il successo dell’AI dipenderà dalla qualità dei dati su cui sarà addestrata, e quest’ultima è strettamente legata alle abilità del professionista, medico o chirurgo.

Startup e istituzioni: attuali protagonisti dell’innovazione

Attualmente tuttavia, i principali protagonisti dell’innovazione tecnologica in ambito sanitario non sono i sistemi sanitari o il personale medico, ma le startup, aziende caratterizzate da modelli di business innovativi e orientati alla rapida scalabilità. Il loro obiettivo è spesso quello di espandersi velocemente all’interno di settori consolidati o nuovi mercati. Tra gli esempi più interessanti troviamo Imagene, una startup israeliana che sfrutta l’intelligenza artificiale per identificare biomarcatori tumorali e prevedere le risposte ai trattamenti; WideLabs, realtà brasiliana che utilizza modelli linguistici avanzati per creare contenuti biografici personalizzati per pazienti con Alzheimer e anticipare la diagnosi della malattia; e Cerebriu, azienda danese che impiega l’AI per ridurre i tempi di analisi delle scansioni cerebrali ottenute tramite risonanza magnetica.

Al fianco di queste realtà emergenti, si posizionano grandi attori istituzionali e tecnologici. Tra questi, l’Organizzazione Mondiale della Sanità, che guida il dibattito sulla regolamentazione dell’uso dell’AI in medicina, e colossi affermati come Oracle, che fornisce infrastrutture cloud avanzate per l’addestramento dei modelli di intelligenza artificiale.

La trasformazione è già in atto e progredisce a un ritmo sempre più rapido. Tuttavia, restano aperti i dibattiti su come questa rivoluzione possa essere guidata in modo da massimizzare il benessere collettivo e ridurre le disuguaglianze, sottolineando l’urgenza di definire un equilibrio tra innovazione tecnologica, etica e accessibilità.

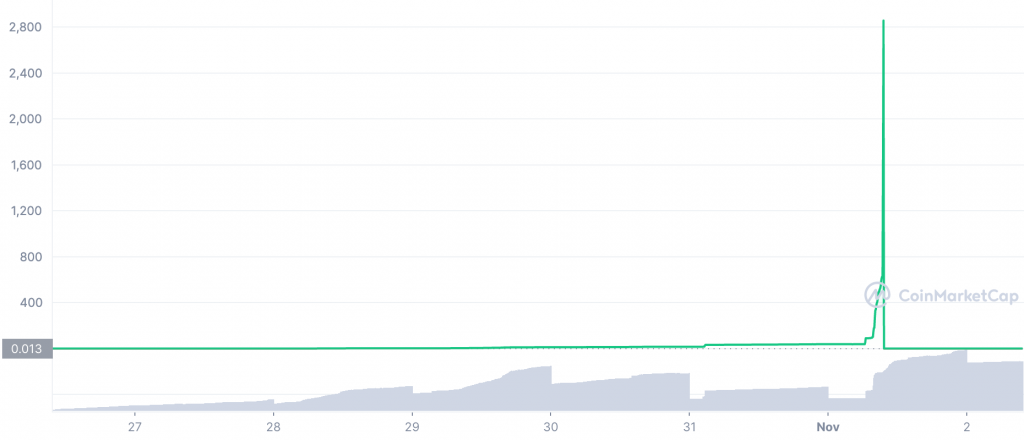

Da un lato, le startup, con la loro capacità di attrarre investimenti e generare innovazione, rappresentano un motore economico di straordinaria importanza. Queste realtà, spesso fondate da team multidisciplinari che includono ingegneri, medici e bioinformatici, stanno guidando una nuova era della medicina digitale. Secondo recenti dati, le startup del settore AI in sanità hanno raccolto miliardi di dollari in finanziamenti, catalizzando lo sviluppo di tecnologie avanzate come algoritmi di monitoraggio per trial clinici e piattaforme per la medicina predittiva.

Un esempio concreto del valore economico e sociale dell’AI è rappresentato dagli algoritmi che monitorano in tempo reale i trial clinici, identificando anomalie e accelerando il processo di approvazione dei farmaci. Startup come Imagene, che utilizzano approcci innovativi come il self-supervised learning per superare i limiti dei dataset ridotti o non etichettati, stanno dimostrando che è possibile ridurre i bias geografici ed etnici, migliorando così la cura delle minoranze meno rappresentate nei materiali impiegati per l’apprendimento degli algoritmi. Tuttavia, anche modelli avanzati richiedono aggiornamenti costanti, risorse computazionali elevate e una supervisione umana accurata.

Parallelamente, le istituzioni sanitarie e politiche assumono un importante ruolo nel guidare e regolamentare questa trasformazione. L’Unione Europea, attraverso l’AI Act, sta sviluppando normative che definiscono standard di sicurezza ed equità per l’uso dell’AI, con un’attenzione particolare al settore sanitario. “Senza una regolamentazione chiara e condivisa, sottolinea Fabrizio D’Alba, rischiamo di perdere di vista l’obiettivo finale: migliorare la qualità della cura e ridurre le disuguaglianze”.

Nonostante possano essere previsti alcuni vantaggi economici, l’espansione dell’AI in sanità non è quindi priva di rischi. La concentrazione delle innovazioni tecnologiche in startup private solleva interrogativi su come garantire equità nell’accesso e trasparenza nell’utilizzo dei dati sanitari. Paesi con risorse limitate potrebbero restare esclusi da queste innovazioni, aggravando le disuguaglianze globali. La stessa adozione di tecnologie AI in contesti clinici avanzati può sollevare dubbi etici legati alla sostituzione del giudizio umano con quello di un algoritmo.

Intelligenza artificiale e relazione medico-paziente

L’AI ha il potenziale di migliorare la qualità delle cure, ma non deve compromettere il cuore della professione medica: il rapporto umano tra medico e paziente. Se utilizzata correttamente, può supportare i professionisti nel prendere decisioni più informate e rapide, lasciando loro più tempo per instaurare una relazione empatica con il paziente. Come osservato da Dean Bitan, cofondatore di Imagene, l’AI non è solo uno strumento per aumentare l’efficienza, ma anche un mezzo per estendere l’accesso a cure di alta qualità, persino in aree rurali e svantaggiate.

Tuttavia, un’adozione indiscriminata e poco critica della tecnologia potrebbe compromettere il ruolo decisionale del medico, riducendo il suo apporto a semplice supervisore di algoritmi. La formazione dei professionisti sanitari deve quindi diventare una priorità, per consentire loro di integrare l’AI nella pratica clinica senza rinunciare al loro ruolo centrale. Come evidenziato durante il Forum Sanità 2024, “la tecnologia non sostituirà mai la sensibilità e il giudizio umano, ma può amplificarne l’efficacia quando utilizzata con consapevolezza”.

Collaborazione tra algoritmo e professionista umano

L’intelligenza artificiale rappresenta quindi una straordinaria opportunità per trasformare il settore sanitario, ma la sua diffusione deve essere guidata da principi di equità, sicurezza e responsabilità. Startup, istituzioni e professionisti sanitari devono collaborare per creare un ecosistema in cui l’innovazione tecnologica sia al servizio delle persone, non viceversa.

Solo un approccio consapevole e collaborativo potrà garantire che l’AI diventi un alleato indispensabile, migliorando non solo la qualità delle cure, ma anche il benessere complessivo della società. La vera sfida non è solo sviluppare tecnologie avanzate, ma far sì che queste possano essere accessibili e utili per tutti, contribuendo a una sanità più giusta, inclusiva e umana.

Fonti

- Annual Review of Biomedical Data Science Probabilistic Machine Learning for Healthcare Irene Y. Chen